Große Erkenntnisumbrüche haben regelmäßig das Bild des Menschen von sich selbst ins Wanken gebracht. Stehen wir vor dem nächsten herben Rückschlag?

Der Mensch als Krone der Schöpfung? Die Idee hat der alte Aristoteles mit seiner Scala Naturae in die Welt gesetzt. Er hat belebte und unbelebte Welt in eine Ordnung gebracht und das komplizierteste Wesen an die Spitze gesetzt – den Menschen. Die Schöpfungsgeschichte der Bibel kennt diese Ordnung auch. Gehalten hat diese Selbst-Vorstellung des Menschen mit der Erde im Mittelpunkt immerhin über eineinhalb Jahrtausende.

Ab dann haben die großen Enttäuschungen ihren Lauf genommen, ausgelöst durch die naturwissenschaftliche Revolution vor gut 500 Jahren.

Die erste große Enttäuschung ist mit Kopernikus verbunden. Die Erkenntnis, dass die Erde keineswegs der Mittelpunkt des Universums ist, führte zu einer ziemlich tiefgreifenden Erschütterung („kosmologische Enttäuschung“). Von wegen was Besonderes, um das sich alles dreht! Daran hat sich die Menschheit nach schmerzvollen Kämpfen gewöhnt.

Dann kam Charles Darwin, der mit seiner Evolutionstheorie die „biologische Enttäuschung“ bescherte. Dagegen ziehen heute noch einflussreiche starke Gruppen zu Felde, die die Lehre aus Schulbüchern verbannen wollen. Gegen die Erkenntnis hilft es nicht.

Mit Sigmund Freud breitet sich schließlich die Erkenntnis aus, dass es gar nicht so gut bestellt ist um die Herrschaft des freien, bewussten Willens, sondern ganz andere Einflüsse unser Handeln wesentlich beeinflussen. („Psychologische Kränkung“).

Worauf können wir noch vertrauen?

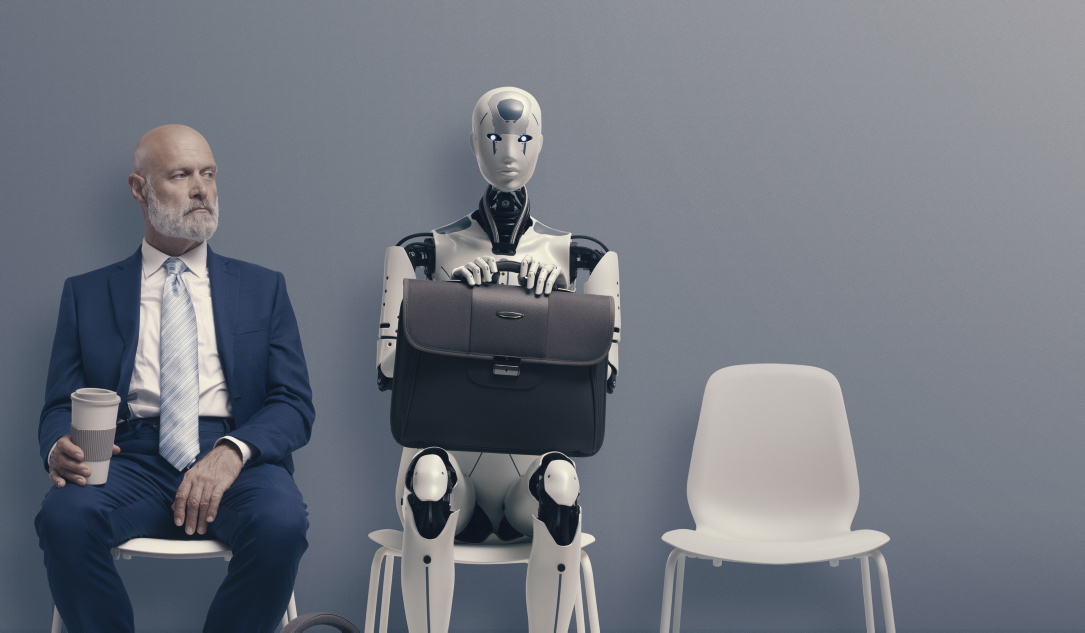

Was blieb für die Vorstellung einer Sonderstellung des Menschen, waren Intelligenz und die Fähigkeit zur Moral. Beim Thema Intelligenz wird die Zahl der Fragezeichen immer größer. Stehen wir vor der nächsten großen Kränkung des Menschen?

Wer – wie wir in der Redaktion – in den vergangenen Wochen zahlreiche Versuche mit den neuesten KI-Errungenschaften gemacht hat, dürfte sich schnell in einer zwiespältigen Gefühlswelt wiedergefunden haben, irgendwo zwischen einer gewissen Faszination und einer Ahnung von der Verwirklichung dystopischer Science-Fiction-Visionen.

Es ist das Spannungsfeld mit dem Blick auf eine ganz neue mögliche Welt. Schüler und Studentinnen müssen Arbeiten nicht mehr selbst schreiben. Die Vorstellung begeistert die einen und ist für die anderen der blanke Horror. Es ist aber, wie es scheint, nur die geringste – und lösbarste – Herausforderung. Vieles andere hat der Ethikrat zutreffend beschrieben.

Eine zentrale Frage, die an die Substanz geht, ist: Worauf können wir zukünftig noch vertrauen? Während Forscher und Wissenschaftlerinnen einräumen, selbst noch gar nicht so ganz genau zu verstehen, was da eigentlich abgeht, sind die Ergebnisse schon in der Welt.

Das Sprachmodell GPT-3 antwortet auf unsere Frage, woran wir erkennen können, ob seine Antworten stimmen: „Meine Antworten sind nicht immer wahr oder falsch, sondern basieren auf statistischen Wahrscheinlichkeiten, die auf der Basis des Trainingsdatensatzes berechnet werden.“ Und dann erhalten wir den Tipp, „kritisch zu bleiben und die von mir gegebenen Antworten mit anderen Quellen zu überprüfen, um sicherzustellen, dass sie wahrheitsgemäß und zuverlässig sind“. Und wenn die „anderen Quellen“ dann auch von einem Sprachmodell stammen? Dabei reden wir noch gar nicht von der gezielt missbräuchlichen Verwendung.

Wenn damit aber bei allem infrage steht, ob ich es glauben, darauf vertrauen darf, geht das an einen Kernbestand unseres Zusammenlebens.

Bei weiteren Versuchen hat uns das Modell eine klar falsche Antwort über eine Person geliefert. Wir haben gefragt, wie sie darauf kommt. Antwort: eine wortreiche Entschuldigung – aber keine Erklärung. Das kommt im „normalen“ Leben zwischen Menschen auch vor. Nur kann ich meinem Gegenüber dann in die Augen sehen und einschätzen, ob er/sie künftig aus diesem Fehler Konsequenzen zieht. Ansonsten wäre das Vertrauen nachhaltig gestört. Eine Welt, in der das nicht ein Einzelfall, sondern „Normalität“ wäre, wäre schlicht die nächste große Enttäuschung.